Tekst: Basert på et foredrag av Eskil G Sivertsen, spesialrådgiver, Forsvarets forskningsinstitutt, under Service- og tjenestekonferansen 2024 (les mer nederst i artikkelen)

|

| Oversikt over Russlands økosystem med manipulasjon og desinformasjon. Kilde: Sivertsen, FFI |

Betydelig trussel mot norsk sikkerhet

Denne artikkelen dykker inn i hvordan disse operasjonene utføres og hva som er mulige konsekvenser for demokratiet og samfunnets stabilitet.

– Kampen om sannhet og tillit foregår nå på nett og i sosiale medier. Russland, Kina og i noen grad Iran har blitt de største statlige aktørene i denne krigen, sier Sivertsen, og tegner opp et ganske dystert bilde av dagens virkelighet.

Russland skiller seg spesielt ut som en betydelig trussel mot norsk sikkerhet, både fordi de aktivt påvirker oppfatninger om sensitive saker som Ukraina-konflikten, og fordi de setter agendaen for andre aktører som kopierer deres metoder. Dette innebærer blant annet desinformasjonskampanjer, falske nyhetsartikler og manipulasjon av sosiale medier.

Målet er å undergrave tilliten

Russlands påvirkningsstrategier fokuserer særlig på å undergrave vestlig støtte til Ukraina, skape splid i vestlige samfunn, og svekke tilliten til pressen og myndighetene. Samtidig benytter Kina seg av lignende metoder for å fremme sitt image, og angripe stater og personer som står opp mot dem. Eksempler på slike operasjoner inkluderer bruk av falske profiler og nyhetsportaler for å spre propaganda og støtte bestemte narrativer (1).

Utnyttelse av hendelser og eksisterende frykt

For å forsterke sin påvirkning benytter Russland en strategi som kombinerer langsiktig manipulasjon med opportunistiske grep ved aktuelle hendelser. Dette ble tydelig da de raskt spredte rykter etter en knivstikking i Southport. Falske påstander om at en muslimsk gutt sto bak hendelsen førte til opprør i høyreradikale miljøer, og russiske aktører bidro til å spre disse ryktene for å skape ytterligere konflikt.

Desinformasjon som big business

Manipulasjon og spredning av falske nyheter er blitt en milliardindustri. Store nettverk av falske nyhetssider, portaler og influensere er dedikert til å generere trafikk og inntekter ved å produsere kontroversielt innhold, uten hensyn til hva som er sannheten. Kunstig intelligens (KI) spiller også en stadig større rolle her, både til produksjon av innhold og ved bruk av bot-nettverk (2) som sikrer maksimal spredning.

|

| Eksempler på falske demonstrasjoner der pensjonister blir tilbudt penger for å stille opp. Kilde: Sivertsen, FFI |

Eksempler på operasjoner og metoder

Russland har også blitt beskyldt for å stå bak falske nyhetssider som etterligner etablerte medier som The Guardian og Der Spiegel. Gjennom slike kloner spredte de artikler som så ut til å være ekte, med mål om å påvirke den offentlige opinionen. Også demonstrasjoner og offentlige samlinger blir brukt strategisk av russiske aktører for å skape uro og tiltrekke seg oppmerksomhet.

Kognitiv forvirring og effekten av gjentakelse

– Vi er mye mindre rasjonelle enn det vi tror, sier Sivertsen. – Ved å spille på menneskers kognitive biaser (3), som bekreftelses- og gjentakelseseffekter, kan Russland få folk til å tro på gjentatte påstander, selv når de er falske. Dette gjør det vanskelig å motstå påvirkningen, fordi kjente narrativer og kilder brukes for å styrke innholdets troverdighet.

|

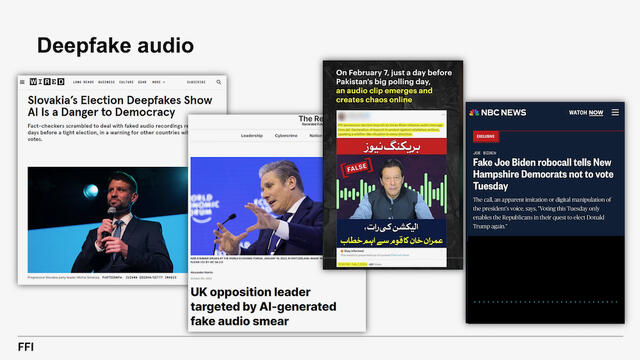

| Eksempler på forfalskning av taler og utsagn fra personer i Slovakia, Storbritannia, Pakistand og USA. Kilde: Sivertsen, FFI |

Fremtiden for påvirkning med KI

Med utbredelsen av KI er det forventet at påvirkningsoperasjoner blir enda vanskeligere å avsløre. KI-genererte bilder og dype stemmekloner benyttes for å skape realistisk, men falskt innhold som raskt spres og blir en del av samfunnsdebatten. Dette har vært synlig i valgkampanjer, hvor manipulasjon kan påvirke velgere uten at det er lett å bevise en direkte sammenheng mellom falskt innhold og valgresultater.

Hvordan beskytte oss?

– For å motvirke slike påvirkningsoperasjoner kreves det ikke bare kildekritikk, men også en forståelse av våre egne kognitive svakheter og hvordan Internett brukes til manipulasjon, sier Sivertsen avslutningsvis. – Videre bør plattformer reguleres for å motvirke algoritmers tendens til å forsterke polarisering. Det er også nødvendig å avdekke falske nettverk og profiler for å beskytte demokratiet mot utenlandske påvirkningsforsøk.

Forklaring av ord brukt i artikkelen

|

(1) Ordet narrativ betyr en fortelling eller historie, ofte brukt for å beskrive en bestemt måte å fremstille eller forstå noe på. I mange sammenhenger viser narrativ til en strukturert fortelling som formidler et bestemt perspektiv, en oppfatning eller en vinkling på virkeligheten. I diskusjoner om politikk, media og påvirkningsoperasjoner, refererer narrativ ofte til hvordan ulike aktører presenterer hendelser og fakta for å påvirke hvordan folk tolker en sak eller situasjon. (2) Et bot-nettverk (eller botnet) er en samling av datamaskiner, enheter eller kontoer som er infisert med programvare som gjør dem i stand til å bli kontrollert eksternt av en aktør, ofte uten at eieren av enhetene er klar over det. Disse enhetene, kalt bots, kan utføre ulike handlinger samtidig på internett. I konteksten av påvirkningsoperasjoner og sosiale medier brukes bot-nettverk til å spre innhold, som desinformasjon eller propaganda, på en omfattende og koordinert måte. Disse botsene kan for eksempel automatisk like, kommentere, eller dele innhold for å gi inntrykk av at mange mennesker støtter en sak eller et narrativ. Dette forsterker inntrykket av en populær mening, noe som kan påvirke hvordan ekte brukere oppfatter og engasjerer seg i innholdet. (3) Kognitive biaser er systematiske feil i måten vi tenker og tolker informasjon på. De er mentale snarveier som hjernen vår bruker for å ta raske beslutninger, men som ofte fører til skjevheter i vurderinger og oppfatninger. Disse biasene kan påvirke hvordan vi ser på oss selv, andre, og hendelser rundt oss. Noen vanlige eksempler på kognitive biaser er:

Kognitive biaser kan gjøre oss mer sårbare for påvirkning, desinformasjon, og manipulasjon, fordi de ofte skjer automatisk uten at vi legger merke til dem. |

Om artikkelen

- Basert på et foredrag av Eskil Grendahl Sivertsen, spesialrådgiver, Forsvarets forskningsinstitutt, under Service- og tjenestekonferansen 2024. Sivertsen er spesialrådgiver tilknyttet C-SPI-prosjektet (Cyber-Social Propaganda & Influence)

- Alle foto/illustrasjoner i artikkelen er fra Sivertsens presentasjon

- Taleopptak av presentasjonen ble transkribert ved hjelp av Jojo/NB-Whisper Large

- Råteksten er bearbeidet og forkortet med ChatGPT før den ble ferdigstilt av Torbjørn Vinje, daglig leder, Forum for offentlig service